作者 / Google DeepMind 研究副总裁 Clement Farabet 和 Google DeepMind 小组产品经理 Olivier Lacombe

今天,我们正式推出Gemma 4—— 这是我们迄今为止最智能的开放模型。Gemma 4 专为高级推理和智能体 (Agentic) 工作流而设计,实现了单位参数下前所未有的智能水平。这一突破性进展源于社区的巨大推动力: 自第一代模型发布以来,Gemma 的下载量已突破 4 亿次,并构建了一个拥有超过 10 万个衍生模型且充满活力的Gemmaverse生态系统。我们密切关注开发者对 AI 未来愿景的渴望,并以 Gemma 4 作为回馈: 依托Apache 2.0 许可,我们将这些突破性能力交到每一位创新者手中。

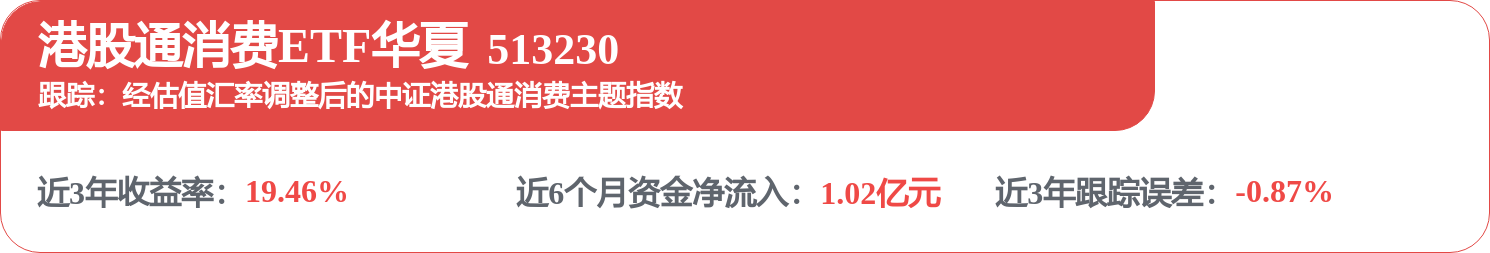

△ 截至 4 月 1 日,Arena.ai的 Chat Arena 中开放模型的性能与参数规模对比。

Gemma 4 基于与 Gemini 3 相同的世界级研究和技术构建,是您可以在自有硬件上运行的最强模型系列。它们与我们的 Gemini 模型相辅相成,为开发者提供了业内最强大的开放工具与专有工具组合。

业界领先的能力与移动优先的 AI

我们共发布了四种不同规格的 Gemma 4:Effective 2B (E2B)、Effective 4B (E4B)、26B 混合专家模型 (MoE)以及31B Dense。全系列模型已不仅仅局限于简单的对话,而是能够轻松处理复杂的逻辑和智能体工作流。

我们更大规格的模型在同等规模下展现出了顶尖的性能。其中,31B 模型目前在行业标准的Arena AI 文本排行榜上名列全球开放模型第 3 位,26B 模型则名列第 6 位。在榜单中,Gemma 4 的表现甚至超越了规模达其 20 倍的模型。对于开发者而言,这种单位参数智能水平的新高度意味着只需极低的硬件开销,即可获得前沿模型级别的能力。

在边缘侧,我们的 E2B 和 E4B 模型重新定义了设备端的实用性,它们优先考虑多模态能力、低延迟处理以及无缝的生态集成,而非单纯追求参数规模。

性能强劲,触手可及,全面开放

为了赋能下一代开拓性研究和产品,我们专门设计了 Gemma 4 的模型规模,使其能够在各种硬件上高效运行和微调 —— 从全球数十亿台 Android 设备到笔记本电脑 GPU,再到开发者工作站和加速器。

借助这些深度优化的模型,您可以微调 Gemma 4 以在特定任务上实现顶尖的性能。这种方法已取得显著成效: 例如,INSAIT 构建了以保加利亚语为优先的语言模型 (BgGPT),我们还与耶鲁大学合作开展了Cell2Sentence-Scale项目,用于探索癌症治疗的新途径。

Gemma 4 之所以能成为我们迄今最强大的开放模型系列,归功于以下核心特质:

高级推理: 能够进行多步规划和深度逻辑推理,Gemma 4 在需要此类能力的数学和指令遵循基准测试中表现出显著的提升。

智能体工作流: 原生支持函数调用 (Function-calling)、结构化 JSON 输出和原生系统指令,助您构建能够与不同工具和 API 交互并稳定执行工作流的自主智能体。

代码生成: Gemma 4 支持生成高质量的离线代码,能够将您的工作站转变为本地优先的 AI 代码助手。

视觉与音频: 所有模型均原生支持视频与图像处理,支持可变分辨率,并在 OCR (光学字符识别) 和图表理解等视觉任务中表现出色。此外,E2B 和 E4B 模型还具备原生音频输入功能,可用于语音识别和理解。

更长的上下文: 可无缝处理长文本内容。边缘模型支持 128K 上下文窗口,更大参数的模型则提供高达 256K 的支持,让您可以在单次提示中处理整个代码库或长篇文档。

支持 140 多种语言: Gemma 4 经过 140 多种语言的原生训练,帮助开发者为全球用户构建包容、高性能的应用。

适配各类硬件的灵活模型

我们发布的 Gemma 4 模型权重针对特定硬件和使用场景进行了量身定制,确保您随时随地都能获得顶尖的推理能力:

26B 和 31B 模型:

在个人电脑上实现离线的前沿智能体验

我们未经量化的 bfloat16 权重可以高效适配单个 80GB NVIDIA H100 GPU,旨在为研究人员和开发者在常用硬件上提供顶尖的推理能力。对于本地配置,量化版本可在消费级 GPU 上原生运行,为您的 IDE、编程助手和智能体工作流提供动力。我们的26B 混合专家模型 (MoE)专注于低延迟,推理时仅激活 38 亿参数,提供极快的每秒 Token 生成数;而31B Dense则追求极致的原始质量,为微调提供了强大的基础。

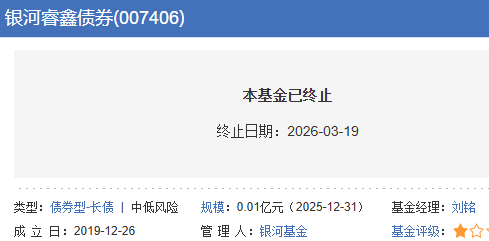

△这些模型通过大量不同的数据集和指标进行了评估,以涵盖文本生成的各个方面。请前往我们的Model Card中查看其他的基准测试。

E2B 和 E4B 模型:

移动和物联网设备智能的新高度

这些模型从底层开始构建,旨在实现计算和内存效率的最大化,在推理时分别激活 20 亿和 40 亿的有效参数,以节省内存和延长电池寿命。通过与 Google Pixel 团队以及高通 (Qualcomm Technologies)、联发科 (MediaTek) 等移动硬件领军企业的紧密合作,这些多模态模型可以在手机、树莓派 (Raspberry Pi)、NVIDIA Jetson Orin Nano 等边缘设备上实现近乎零延迟的完全离线运行。Android 开发者现在即可在AICore 开发者预览版中原型化智能体流程,实现与 Gemini Nano 4 的前向兼容。

开源许可

我们悉心听取了大家的反馈。构建 AI 的未来需要通力合作,我们相信赋能开发者生态不应设限。因此,Gemma 4 采用商业友好的Apache 2.0 许可发布。

Apache 2.0 许可

https://goo.gle/gemma-4-apache-2

这一开源许可为开发者实现充分的灵活性和数字主权奠定了基础,赋予您对数据、基础架构和模型的完全控制权。它允许您在任何环境 (无论是本地部署还是云端) 中自由构建并安全部署。

"Gemma 4 采用 Apache 2.0 许可发布是一个巨大的里程碑。我们非常激动能在发布首日就在 Hugging Face 上支持 Gemma 4 系列。"

Clément Delangue,Hugging Face 联合创始人兼 CEO

以信任与安全为基石

和我们的专有模型一样,这些模型遵循严苛的基础架构安全协议。通过选择 Gemma 4,企业和主权组织可以获得一个值得信赖且透明的基础,在满足最高安全和可靠性标准的同时,交付顶尖的能力。

多元选择的生态系统

立即开始试验: 即刻获取 Gemma 4 访问权限并开始构建。在Google AI Studio(31B 和 26B MoE) 或 GoogleAI Edge Gallery(E4B 和 E2B) 中探索 Gemma 4。在Android 开发方面,可使用它驱动Android Studio中的智能体模式 (Agent Mode),并开始使用ML Kit GenAI Prompt API构建可投入生产环境的 Android 应用。

使用您喜爱的工具: 发布首日即支持Hugging Face(Transformers, TRL, Transformers.js, Candle),LiteRT-LM, vLLM, llama.cpp,MLX,Ollama,NVIDIA NIM和NeMo,LM Studio,Unsloth, SGLang, Cactus,Baseten,Docker, MaxText, Tunix, Keras,您可以根据项目需求灵活选择最合适的工具。

下载模型: 前往Hugging Face、Kaggle或Ollama获取模型权重。

根据您的特定需求定制 Gemma 4: 借助您首选的平台 (如 Google Colab、Vertex AI甚至您的游戏 GPU) 对模型进行训练与适配。

在 Google Cloud 上扩展至生产环境: 虽然本地设备端推理是离线使用的理想选择,但 Google Cloud 打破了所有算力瓶颈。您可以根据需求通过 Vertex AI、Cloud Run、GKE、Sovereign Cloud 及 TPU 加速推理服务进行部署,并获得针对受监管工作负载的最高级别合规保障。您可以进一步了解如何在 Google Cloud 上快速入门。

跨多硬件平台加速 AI 开发:Gemma 4 针对业界领先的硬件进行了优化,实现开箱即用。您可以在从 NVIDIA Jetson Orin Nano 到 Blackwell GPU 的 NVIDIA AI 基础设施上体验极致性能,通过开源 ROCm 栈与 AMD GPU 集成,或在 Trillium 和 Ironwood TPU 上进行大规模部署和高效运算。

以技术创造深远影响:参加 Kaggle 上的Gemma 4 Good 挑战赛,构建能够为世界带来深远且积极影响的作品。

- 随机文章

- 热门文章

- 热评文章

- 人民币兑美元中间价报7.0956 调贬9个基点

- 美高梅集团总裁:积极参与文旅高质量发展,持续加码中国市场

- 上海农商银行“鑫动能研发贷”助力企业攻坚硬核科技核心技术

- 做CT、人工智能模型……古城墙还可以这样保护

- 市政府代表团出访欧洲三国 推动多领域交流合作 共享发展新机遇 同谱合作新篇章

- 站稳普惠定位 助力健康中国――中国人寿寿险公司政策性健康险的十年探索

- ATFX汇市:欧元区和美国的制造业PMI将发布,市场预期乐观

- 浙江休闲农业去年接待3.6亿人次 营业收入达471亿元

- 焦点访谈丨警惕手机里的“李鬼” 遇到这种APP赶紧删

- “特种兵椰汁”商标认定无效 最高检:商标不得损害国家和社会公共利益

- 美国多地高校因巴以局势爆发大规模示威,我驻美使馆发提醒

- 全球债市焦点:日本维持购债,美国通胀粘性,投资者何去何从?

- 天齐锂业:境外少数股东收益暴增,SQM核心锂业务面临变动风险!

- 1“赛事+”提升城市“流量” 陕西商洛拓经济发展新“赛道”

- 2华发股份:成功入选“人民优选”品牌 五一黄金周热销30亿

- 3“五一”临近 持基过节的投资者要注意这几点

- 4钟鼓楼老街区的古都新事

- 5到2027年产业规模达到2000亿元 浙江发布历史经典产业高质量发展计划

- 6非常危险!女子摔成粉碎性骨折!又是因为洞洞鞋,夏天多人中招……

- 7金税四期试点上线,财税体制改革拉开帷幕!或有资金借道信创ETF基金(562030)逢跌进场布局

- 8初步数据:我国一季度经常账户顺差392亿美元

- 9IDC:24Q1全球PC出货量恢复增长 达到疫情前水平

- 10“发现山西之美”TDC旅游发现者大会举办:共话文旅新生态 邀客体验新玩法

- 11国门“夫妻档” 国庆共坚守

- 12北交所一周审核动态:2家企业更新进展 胜业电气二轮问询回复中称家电头部客户对价格敏感度较低

- 13(中国新貌)“国宝”大熊猫:栖居更美境 云游更广天

- 1大裁员下,特斯拉两名顶级高管离职

- 2奇瑞将与欧洲高端品牌签署技术平台授权协议

- 32024中国长三角青年企业家交流大会在杭州举办

- 4雷克萨斯GX中东版 全部在售 2023款 2022款 2020款 2019款 2018款成都远卓名车雷克萨斯GX中东版团购钜惠20万 欢迎上门试驾

- 5零跑C16将搭载中创新航磷酸铁锂电池

- 6Q1净利微增7%,宁德时代股东总数较2023年年末减少10728户

- 7哪吒,需要背水一战

- 8“新”中有“机”!创新服务承接新流量 撬动消费升级

- 9非创始版SU7何时交付 小米:工厂生产爬坡 全力提高产能

- 10央媒评卧铺挂帘:谁买的票谁做主

- 11江西南昌首部“多规合一”国土空间总体规划获批

- 12方程豹旗舰硬派越野!豹8正式亮相:仰望U8“青春版”登场

- 13583家族/造型霸气 方程豹豹8量产版发布